MÜNCHEN (IT BOLTWISE) – In der Welt der Softwareentwicklung spielen große Sprachmodelle (LLMs) eine zunehmend wichtige Rolle. Doch die traditionellen Benchmarks zur Bewertung ihrer Programmierfähigkeiten stoßen an ihre Grenzen.

Mit der fortschreitenden Entwicklung von großen Sprachmodellen (LLMs) zur Unterstützung der Programmierung wird die Notwendigkeit neuer Bewertungsmaßstäbe immer deutlicher. Obwohl viele dieser Modelle in traditionellen Benchmarks wie HumanEval und MBPP hohe Punktzahlen erzielen, bleibt die Frage offen, welches Modell für spezifische Softwareentwicklungsprojekte am besten geeignet ist.

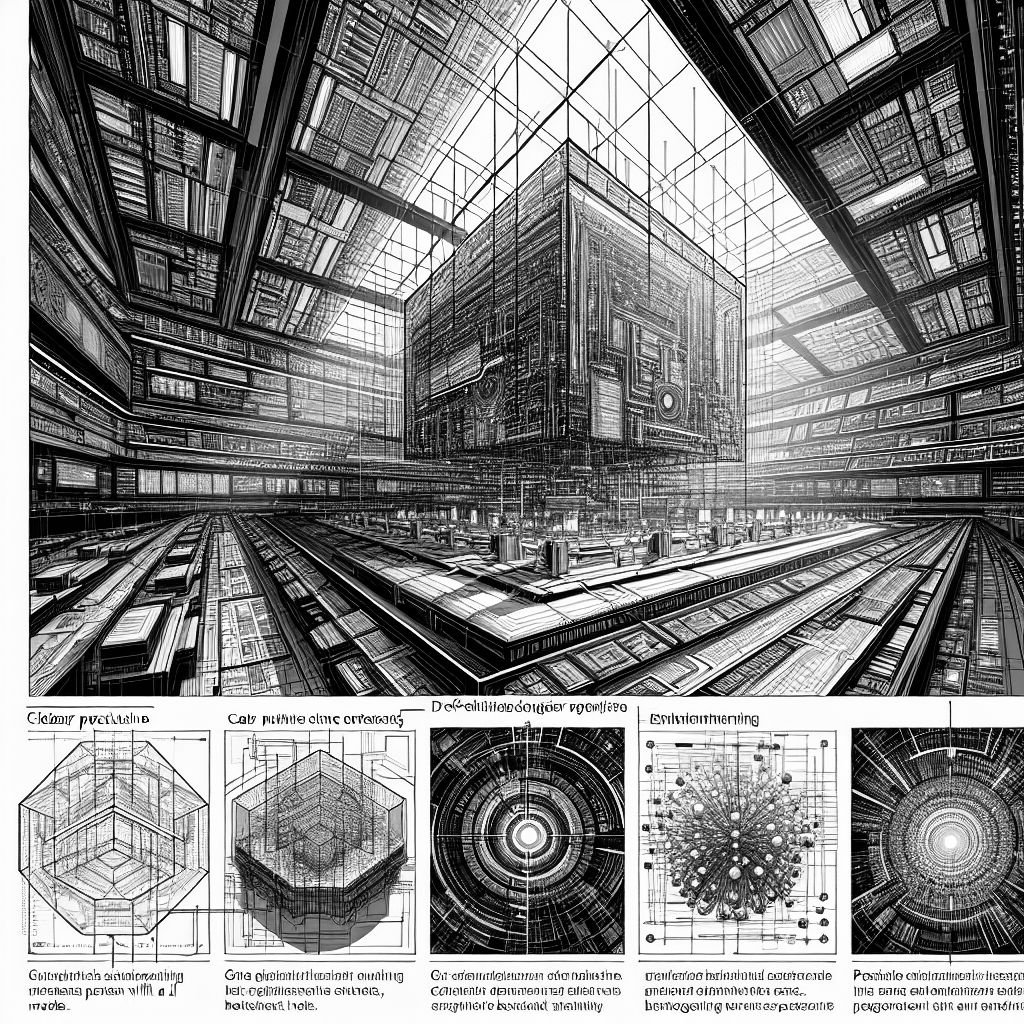

Forscher der Yale University und der Tsinghua University haben eine innovative Methode entwickelt, um die Fähigkeit von Modellen zur Lösung von ‘selbstaufrufenden Code-Generierungsproblemen’ zu testen. Diese Probleme erfordern nicht nur das Erstellen von Code, sondern auch das Wiederverwenden bestehender Lösungen, was realistischen Programmieraufgaben näherkommt als herkömmliche Tests.

Die selbstaufrufende Code-Generierung stellt eine bedeutende Herausforderung dar, da sie die Fähigkeit eines Modells prüft, seinen eigenen generierten Code in komplexeren Aufgaben zu nutzen. Dies ist ein entscheidender Aspekt, den aktuelle Benchmarks nicht ausreichend erfassen. Um diese Fähigkeit zu testen, haben die Forscher die Benchmarks HumanEval Pro und MBPP Pro entwickelt, die auf den bestehenden Datensätzen aufbauen und zusätzliche Elemente einführen, die die Modelle dazu zwingen, ihre Lösungen zu erweitern.

Ein Beispiel für eine solche Aufgabe wäre, eine Funktion zu schreiben, die mehrere Zeichen in einem String ersetzt, wobei die Lösung auf einer zuvor generierten Funktion basiert, die nur ein Zeichen ersetzt. Diese Art der Bewertung bietet tiefere Einblicke in die Programmierfähigkeiten von LLMs und geht über die einfache Generierung von Code hinaus.

Die Tests der Forscher zeigten, dass viele Modelle, die in traditionellen Benchmarks gut abschneiden, bei selbstaufrufenden Code-Generierungsaufgaben Schwierigkeiten haben. So erreichte beispielsweise das Modell o1-mini bei HumanEval Pro nur 76,2 %, während es bei HumanEval 96,2 % erzielte. Dies verdeutlicht die Diskrepanz zwischen einfachen und komplexeren Programmieraufgaben.

Ein weiterer interessanter Befund ist, dass das Fein-Tuning von Modellen auf Anweisungen bei einfachen Aufgaben erhebliche Verbesserungen bringt, bei komplexeren selbstaufrufenden Aufgaben jedoch weniger effektiv ist. Die Forscher schlagen vor, die Trainingsmethoden für Basismodelle zu überdenken, um deren Fähigkeiten in der Code-Generierung und im logischen Denken zu verbessern.

Um die Forschung in diesem Bereich voranzutreiben, schlagen die Forscher eine Technik vor, um bestehende Coding-Benchmarks automatisch für selbstaufrufende Code-Generierung zu nutzen. Diese Methode minimiert den Bedarf an manueller Code-Überprüfung und erleichtert die Generierung neuer Beispiele.

Diese neuen Benchmarks kommen zu einer Zeit, in der alte Coding-Benchmarks von modernen Modellen schnell erobert werden. Während Modelle wie GPT-4o und Claude 3.5 Sonnet bereits hohe Punktzahlen in HumanEval und MBPP erzielen, zeigen sie bei komplexeren Benchmarks wie SWE-Bench nur mäßige Leistungen. Selbstaufrufende Code-Generierung bietet eine praktische Möglichkeit, die Nützlichkeit von LLMs in realen Szenarien zu bewerten, in denen menschliche Programmierer die Kontrolle haben und KI-Copiloten spezifische Aufgaben im Softwareentwicklungsprozess unterstützen.

- Die besten Bücher rund um KI & Robotik!

- Die besten KI-News kostenlos per eMail erhalten!

- Zur Startseite von IT BOLTWISE® für aktuelle KI-News!

- Service Directory für AI Adult Services erkunden!

- IT BOLTWISE® kostenlos auf Patreon unterstützen!

- Aktuelle KI-Jobs auf StepStone finden und bewerben!

Stellenangebote

Duales Studium BWL - Spezialisierung Artificial Intelligence (B.A.) am Campus oder virtuell

PhD in AI & Data Science for Cancer Research with Real World Impact

Professor für Design, Strategien & KI (m/w/d)

Learning & People Development Manager (m/w/d) mit Fokus auf AI, Data & IT Skills

- Die Zukunft von Mensch und MaschineIm neuen Buch des renommierten Zukunftsforschers und Technologie-Visionärs Ray Kurzweil wird eine faszinierende Vision der kommenden Jahre und Jahrzehnte entworfen – eine Welt, die von KI durchdrungen sein wird

- Künstliche Intelligenz: Expertenwissen gegen Hysterie Der renommierte Gehirnforscher, Psychiater und Bestseller-Autor Manfred Spitzer ist ein ausgewiesener Experte für neuronale Netze, auf denen KI aufbaut

- Obwohl Künstliche Intelligenz (KI) derzeit in aller Munde ist, setzen bislang nur wenige Unternehmen die Technologie wirklich erfolgreich ein

- Wie funktioniert Künstliche Intelligenz (KI) und gibt es Parallelen zum menschlichen Gehirn? Was sind die Gemeinsamkeiten von natürlicher und künstlicher Intelligenz, und was die Unterschiede? Ist das Gehirn nichts anderes als ein biologischer Computer? Was sind Neuronale Netze und wie kann der Begriff Deep Learning einfach erklärt werden?Seit der kognitiven Revolution Mitte des letzten Jahrhunderts sind KI und Hirnforschung eng miteinander verflochten

Du hast einen wertvollen Beitrag oder Kommentar zum Artikel "Selbstaufrufende Code-Benchmarks: Neue Maßstäbe für KI-gestützte Programmierung" für unsere Leser?

#Sophos

#Sophos

Es werden alle Kommentare moderiert!

Für eine offene Diskussion behalten wir uns vor, jeden Kommentar zu löschen, der nicht direkt auf das Thema abzielt oder nur den Zweck hat, Leser oder Autoren herabzuwürdigen.

Wir möchten, dass respektvoll miteinander kommuniziert wird, so als ob die Diskussion mit real anwesenden Personen geführt wird. Dies machen wir für den Großteil unserer Leser, der sachlich und konstruktiv über ein Thema sprechen möchte.

Du willst nichts verpassen?

Du möchtest über ähnliche News und Beiträge wie "Selbstaufrufende Code-Benchmarks: Neue Maßstäbe für KI-gestützte Programmierung" informiert werden? Neben der E-Mail-Benachrichtigung habt ihr auch die Möglichkeit, den Feed dieses Beitrags zu abonnieren. Wer natürlich alles lesen möchte, der sollte den RSS-Hauptfeed oder IT BOLTWISE® bei Google News wie auch bei Bing News abonnieren.

Nutze die Google-Suchmaschine für eine weitere Themenrecherche: »Selbstaufrufende Code-Benchmarks: Neue Maßstäbe für KI-gestützte Programmierung« bei Google Deutschland suchen, bei Bing oder Google News!